A medida que los robots se vuelven más autónomos, inteligentes y presentes en nuestra vida cotidiana, emergen desafíos éticos y legales sin precedentes. Ya no estamos hablando de simples máquinas programadas para realizar tareas específicas, sino de sistemas cada vez más capaces de aprender, tomar decisiones y, en algunos casos, desarrollar comportamientos no explícitamente programados.

Esta evolución plantea preguntas fundamentales sobre cómo debemos diseñar, regular e integrar estas tecnologías en nuestra sociedad. En este artículo, exploramos los principales dilemas éticos y desafíos legales que enfrenta el campo de la robótica en la actualidad.

Responsabilidad legal: ¿Quién responde cuando un robot falla?

Uno de los desafíos más inmediatos y complejos es determinar la responsabilidad cuando un sistema robótico causa daños o perjuicios. A diferencia de las herramientas tradicionales, los robots avanzados con IA pueden tomar decisiones autónomas basadas en su aprendizaje, lo que complica el establecimiento de cadenas claras de responsabilidad.

Consideremos algunas situaciones problemáticas:

- Vehículos autónomos: ¿Quién es responsable en caso de accidente? ¿El fabricante, el desarrollador del software, el propietario o el propio vehículo?

- Robots quirúrgicos: Si un robot comete un error durante una cirugía, ¿la responsabilidad recae en el cirujano supervisor, el hospital, el fabricante o el programador?

- Sistemas de IA adaptativa: Cuando un sistema aprende y evoluciona con el tiempo, ¿puede seguir siendo el fabricante original responsable de comportamientos que emergen meses o años después?

En 2023, la Unión Europea dio un paso significativo con la aprobación del Reglamento de Responsabilidad por IA, que establece un marco de responsabilidad para sistemas de inteligencia artificial. Este reglamento introduce el concepto de "responsabilidad objetiva" para ciertos sistemas de alto riesgo, donde no es necesario demostrar negligencia para establecer responsabilidad.

"Estamos creando entidades que toman decisiones cuyas consecuencias no podemos prever completamente. Nuestros marcos legales actuales, basados en conceptos de intencionalidad y previsibilidad, resultan inadecuados para esta nueva realidad." - Dra. Isabel Fernández, Catedrática de Derecho Tecnológico, Universidad Complutense de Madrid

Algunos expertos proponen la creación de un estatus legal específico para robots autónomos avanzados, similar a la "personalidad electrónica" que el Parlamento Europeo ha considerado. Esto permitiría que los robots mismos (o más bien, los fondos asociados a ellos) pudieran ser responsables por daños, aunque esta propuesta sigue siendo controvertida.

Privacidad y vigilancia: Los robots como recolectores de datos

Los robots modernos son esencialmente plataformas móviles de recopilación de datos. Equipados con cámaras, micrófonos, sensores de movimiento y capacidad de conexión a internet, estos dispositivos pueden registrar aspectos de nuestras vidas que antes permanecían privados.

Esta capacidad plantea serias preocupaciones:

- Robots domésticos que generan mapas detallados de nuestros hogares

- Asistentes robóticos que registran conversaciones privadas

- Robots de seguridad capaces de realizar vigilancia constante

- Sistemas que comparten datos con fabricantes, anunciantes o agencias gubernamentales

El Reglamento General de Protección de Datos (RGPD) en Europa proporciona algunas salvaguardas, pero muchos expertos argumentan que se necesitan regulaciones específicas para robots. La capacidad de estos dispositivos para fusionar y contextualizar datos de múltiples fuentes crea riesgos de privacidad cualitativamente diferentes a los de otras tecnologías.

En España, la Agencia Española de Protección de Datos publicó en 2023 una guía específica sobre "Privacidad en Entornos Robotizados", que establece directrices para fabricantes y usuarios sobre consentimiento, minimización de datos y derecho al olvido aplicados específicamente a sistemas robóticos.

Autonomía y toma de decisiones éticas

A medida que los robots se vuelven más autónomos, surgen preguntas sobre cómo deberían tomar decisiones en situaciones con implicaciones éticas. ¿Pueden y deben los robots estar programados para seguir principios éticos específicos?

El clásico "problema del tranvía" ilustra este dilema: si un vehículo autónomo debe elegir entre atropellar a varios peatones o poner en riesgo a su pasajero, ¿qué decisión debería tomar? Y más importante aún, ¿quién debería decidir qué principios éticos se codifican en estos sistemas?

Algunas aproximaciones incluyen:

- Ética consecuencialista: Programar robots para minimizar el daño total

- Ética deontológica: Establecer reglas absolutas que no deben violarse (similar a las Tres Leyes de la Robótica de Asimov)

- Ética de la virtud: Desarrollar sistemas que aprendan valores y virtudes a través de la experiencia

El Instituto de Ingeniería y Tecnología (IET) ha propuesto un "Juramento Hipocrático para Robots", un conjunto de principios éticos que deberían incorporarse en el diseño y programación de sistemas robóticos avanzados, similar al juramento que hacen los médicos.

Impacto laboral y transformación económica

La automatización robótica plantea profundas cuestiones sobre el futuro del trabajo y la distribución de la riqueza. Aunque históricamente las revoluciones tecnológicas han creado más empleos de los que han eliminado a largo plazo, la velocidad y amplitud de la actual transformación presenta desafíos únicos.

Según un informe reciente del Foro Económico Mundial, para 2025 la automatización podría desplazar 85 millones de puestos de trabajo a nivel mundial, mientras crea 97 millones de nuevos roles. Sin embargo, esta transición no será uniforme ni sencilla:

- Los nuevos empleos requerirán habilidades diferentes a las de los trabajos desplazados

- La redistribución geográfica del trabajo podría dejar atrás a regiones enteras

- Los beneficios económicos de la automatización podrían concentrarse en quienes poseen la tecnología

Varios países están explorando respuestas políticas a estos desafíos:

- Impuestos a robots: Propuestos como forma de financiar la reconversión de trabajadores desplazados

- Renta básica universal: Como mecanismo para distribuir los beneficios de la automatización

- Programas masivos de recualificación: Para ayudar a los trabajadores a adaptarse

- Reducción de jornada laboral: Distribuyendo el trabajo disponible entre más personas

España ha sido pionera en Europa con la creación del "Observatorio de Impacto Social y Ético de la IA y la Robótica", que estudia y propone políticas para gestionar esta transición de manera justa y sostenible.

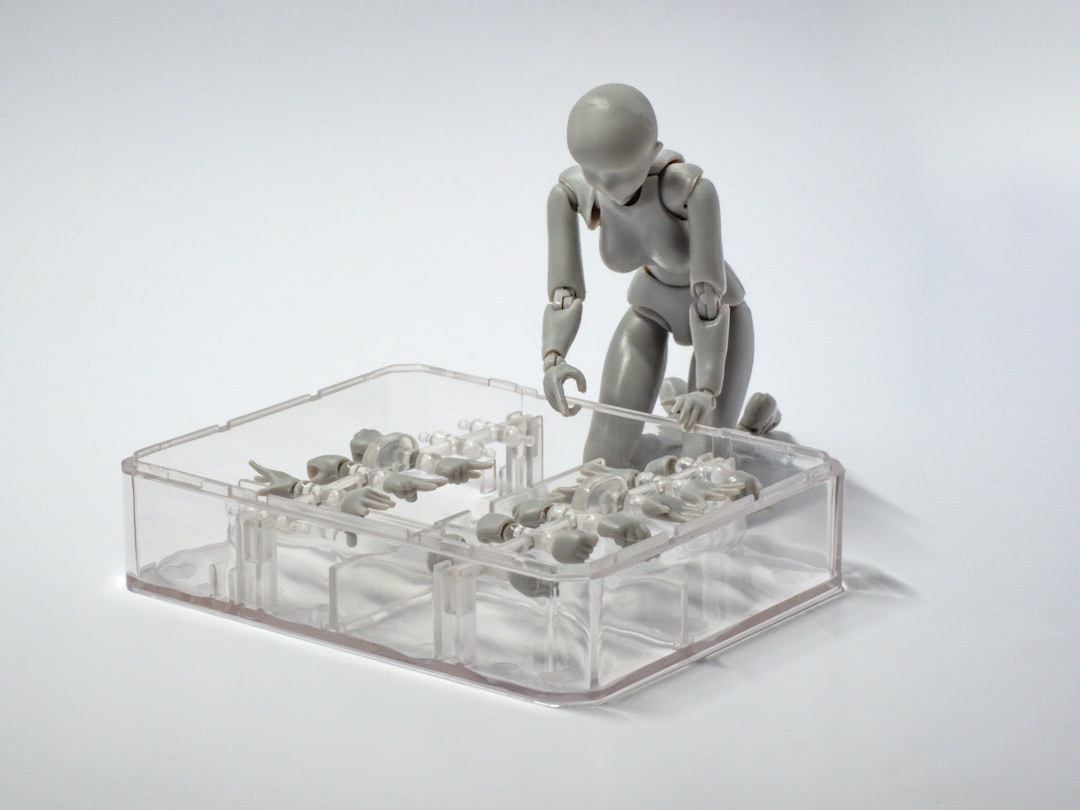

Robots con apariencia y comportamiento humanoide

Los robots diseñados para parecerse y comportarse como humanos plantean cuestiones éticas particulares. ¿Hasta qué punto debemos permitir que los robots imiten características humanas? ¿Qué efectos psicológicos y sociales podría tener esto?

Algunas preocupaciones incluyen:

- Engaño y manipulación: Robots que explotan nuestra tendencia natural a antropomorfizar

- Dilución de lo humano: Posible erosión de lo que consideramos uniquemente humano

- Impacto en relaciones interpersonales: Especialmente en poblaciones vulnerables como niños o ancianos

- Robots sexuales: Implicaciones éticas de dispositivos diseñados para intimidad física

Japón, con su mayor aceptación cultural de robots humanoides, ha sido pionero en desarrollar guías éticas específicas para la interacción humano-robot. El "Código Ético para Robots de Servicio" japonés de 2022 establece que los robots humanoides deben identificarse claramente como no-humanos y limita el grado de manipulación emocional permitido en su diseño.

Robótica militar y armamento autónomo

Quizás el área más controvertida es el desarrollo de sistemas robóticos con capacidades letales. Los sistemas de armas autónomas letales (LAWS, por sus siglas en inglés), coloquialmente llamados "robots asesinos", plantean profundas cuestiones morales y de seguridad internacional.

El debate se centra en si debería permitirse que máquinas tomen decisiones sobre vida o muerte sin supervisión humana significativa. Organizaciones como la campaña "Stop Killer Robots" abogan por un tratado internacional preventivo que prohíba estas armas antes de que se generalicen.

Las preocupaciones incluyen:

- Reducción del umbral para iniciar conflictos armados

- Dificultad para atribuir responsabilidad por violaciones del derecho internacional humanitario

- Carreras armamentísticas impulsadas por IA que podrían desestabilizar el orden internacional

- Proliferación a actores no estatales, incluidos grupos terroristas

Aunque las Naciones Unidas han celebrado varias rondas de discusiones sobre este tema bajo la Convención sobre Ciertas Armas Convencionales, el progreso hacia un tratado vinculante ha sido lento debido a la oposición de algunas potencias militares clave.

Marco legislativo: Avances y deficiencias

El panorama regulatorio actual para la robótica es un mosaico de leyes generales aplicadas a nuevas situaciones, estándares industriales voluntarios y algunos intentos iniciales de legislación específica. Sin embargo, existe un creciente consenso sobre la necesidad de marcos regulatorios más coherentes y específicos.

La Unión Europea ha sido líder mundial en este ámbito:

- El Reglamento de IA de la UE, aprobado en 2023, establece requisitos específicos para sistemas de IA de alto riesgo, incluyendo muchos robots avanzados

- La resolución del Parlamento Europeo sobre "Normas de Derecho Civil sobre Robótica" estableció directrices para futuros desarrollos legislativos

- La creación de un sistema de "marcado CE" específico para robots, similar al existente para productos electrónicos

En España, la "Estrategia Nacional de Robótica e IA" incluye un apartado específico sobre ética y gobernanza, y se ha creado una comisión interministerial para coordinar el desarrollo de regulaciones.

Sin embargo, muchos expertos señalan que estas iniciativas siguen siendo insuficientes dado el ritmo acelerado de desarrollo tecnológico. Áreas como la robótica biomimética, los nanorobots y los sistemas colectivos de robots (enjambres) plantean desafíos regulatorios que apenas se están comenzando a explorar.

El camino hacia adelante: Gobernanza adaptativa

Frente a estos desafíos, está emergiendo un consenso sobre la necesidad de enfoques regulatorios más adaptativos y participativos. Estos incluirían:

- Sandboxes regulatorios: Espacios controlados donde nuevas tecnologías pueden probarse bajo supervisión regulatoria

- Ética por diseño: Incorporación de consideraciones éticas desde las primeras etapas del desarrollo tecnológico

- Evaluaciones de impacto algorítmico: Similar a las evaluaciones de impacto ambiental

- Participación multisectorial: Incluyendo no solo a ingenieros y legisladores, sino también a filósofos, sociólogos y ciudadanos

El Observatorio Español de Ética en IA y Robótica ha propuesto un "modelo de gobernanza en espiral", donde las regulaciones evolucionan continuamente en respuesta a los avances tecnológicos y sus impactos observados, con ciclos regulares de revisión y actualización.

Conclusión: Dando forma al futuro que queremos

Los desafíos éticos y legales que plantea la robótica avanzada no son meramente técnicos, sino profundamente filosóficos y sociales. Las decisiones que tomemos hoy sobre cómo diseñar, regular y utilizar estas tecnologías darán forma al tipo de sociedad en la que viviremos mañana.

Como sociedad, necesitamos un diálogo abierto y participativo sobre qué valores queremos que guíen el desarrollo de la robótica. Este diálogo debe extenderse más allá de los expertos técnicos para incluir perspectivas diversas sobre lo que significa ser humano en una era de máquinas cada vez más inteligentes y autónomas.

El objetivo no debería ser simplemente prevenir daños, sino asegurar que estas poderosas tecnologías se desarrollen de manera que amplíen las capacidades humanas, respeten nuestra autonomía y dignidad, y contribuyan a una sociedad más justa y próspera para todos.